Simcenter PhysicsAI 技术架构与仿真计算及硬件部署指南

时间:2026-03-03 23:24:54

来源:UltraLAB图形工作站方案网站

人气:82

作者:管理员

一、核心技术特征与计算负载分析

Simcenter PhysicsAI 代表了物理信息神经网络(PINNs)与传统多物理场仿真的融合架构,其技术栈包含三个计算层级:

| 计算层级 | 技术特征 | 计算负载类型 | 资源瓶颈 |

|---|---|---|---|

| AI代理模型层 | Surrogate Model替代传统求解器 | 高并发矩阵运算、GPU加速推理 | 显存容量、CUDA核心数 |

| 物理仿真层 | FEA/CFD/电磁场数值求解 | 稀疏矩阵求解、大内存带宽需求 | 内存容量、CPU主频、缓存 |

| 数据驱动优化层 | 设计空间探索(DOE)、拓扑优化 | 并行参数扫描、遗传算法 | 多核扩展性、存储IOPS |

1.1 多物理场耦合计算特征

高保真耦合仿真涉及以下计算模式:

-

流-固耦合(FSI):需同时求解Navier-Stokes方程与结构力学方程,内存占用呈指数级增长

-

热-电耦合:焦耳热与温度场迭代,要求高频低延迟内存访问

-

电磁-热耦合:高频电磁损耗计算,GPU加速效果显著

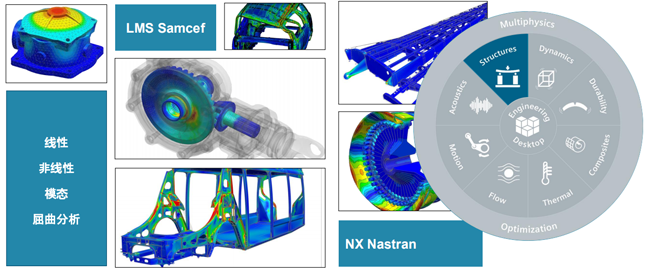

二、分领域应用技术解析与配置方案

2.1 汽车碰撞与车身优化

计算特点

-

显式动力学求解:毫秒级时间步长,数十万个时间步迭代

-

大变形非线性:接触算法密集,单精度计算占比高

-

AI代理加速:通过降阶模型(ROM)将小时级仿真压缩至秒级

软件与系统清单

| 软件组件 | 版本/配置要求 | 操作系统 | 依赖库 |

|---|---|---|---|

| Simcenter PhysicsAI | 2024.1+ | Windows Server 2022 / RHEL 8.6+ | CUDA 12.1, TensorRT 8.6 |

| Simcenter 3D (NX Nastran) | 2024.1 | Windows 11 Pro for Workstations | Intel MKL 2023 |

| LS-DYNA / PAM-CRASH | R13+ | Linux CentOS 7.9+ | MPI (Intel MPI 2021) |

| MATLAB/Simulink | R2024a | 同上 | Python 3.11, PyTorch 2.1 |

硬件配置推荐(车身碰撞AI优化工作站)

yaml

计算节点配置: CPU: AMD Ryzen Threadripper PRO 7995WX (96核192线程, 5.1GHz Boost) 内存: 512GB DDR5-4800 ECC REG (8×64GB, 八通道) 系统盘: 2TB NVMe Gen5 SSD (顺序读12GB/s+) 数据盘: 8TB NVMe Gen4 SSD (企业级) GPU加速: NVIDIA RTX pro5000 (72GB GDDR7, 4×DP) 网络: 双万兆以太网 (RDMA支持) 电源: 1600W 钛金认证 散热: 360mm AIO水冷 + 机箱风道优化

配置逻辑:96核CPU处理显式动力学并行分解,72GB显存支持整车网格(780万+单元)的AI推理加速,八通道内存满足显式求解器对带宽的饥渴需求(>300GB/s)。

2.2 航空航天气动与热管理

计算特点

-

高雷诺数湍流:LES/DES模拟要求精细网格(亿级单元)

-

可压缩流动:马赫数跨度大,矩阵条件数差,迭代收敛慢

-

多目标优化:气动阻力、热防护、结构重量多物理场权衡

软件与系统清单

| 软件组件 | 版本要求 | 操作系统 | 特殊依赖 |

|---|---|---|---|

| Simcenter STAR-CCM+ | 2306+ | RHEL 8.8 / SUSE LE 15 SP4 | CUDA 12.x, OpenMPI 4.1 |

| Simcenter PhysicsAI | 2024.1 | 同上 | NVIDIA cuDNN 8.9 |

| ANSYS Fluent | 2024 R1 | Windows Server 2022 | Intel MPI, .NET 6.0 |

| Pointwise/HexPress | 2023.2 | Linux x64 | OpenGL 4.5+ |

| ModeFrontier | 2023R1 | Windows/Linux | Java 17 |

硬件配置推荐(CFD-AI融合计算服务器)

yaml

集群节点配置: CPU: 2× Intel Xeon Platinum 8490H (120核240线程, 3.5GHz, 112.5MB L3) 内存: 1TB DDR5-4800 ECC (16×64GB, 双路八通道) 存储: - 系统盘: 2× 960GB SATA SSD (RAID 10) - 计算缓存: 7.68TB NVMe SSD - 数据池: 120TB SATA-RAID HDD (RAID5) GPU: 4× NVIDIA H100 80GB PCIe (NVLink桥接) 互联: NVIDIA ConnectX-7 400GbE/IB (支持GPUDirect RDMA) 机箱: 4U机架式, 2000W冗余电源

配置逻辑:H100的Transformer引擎加速PhysicsAI的注意力机制计算,80GB显存容纳全机气动网格;双路Platinum CPU处理边界层网格的稀疏线性系统,1TB内存支持十亿级网格驻留。

2.3 风力发电与能源系统

计算特点

-

旋转机械流场:滑移网格/重叠网格技术,非定常计算成本高

-

流-固-控耦合:气动载荷→结构响应→控制反馈闭环

-

环境不确定性:多工况Monte Carlo分析,天然并行度高

软件与系统清单

| 软件组件 | 配置要求 | 操作系统 | 备注 |

|---|---|---|---|

| Simcenter PhysicsAI | 2024.1 | Windows 10/11 | 降阶模型训练 |

| Simcenter STAR-CCM+ | 2306+ | Linux RHEL 8 | 风机气动分析 |

| FAST / OpenFAST | v3.5+ | Linux | NREL开源, aero-elastic耦合 |

| Bladed | 4.14+ | Windows | 风机载荷计算 |

| Python/TensorFlow | 2.15+ | 跨平台 | surrogate model开发 |

硬件配置推荐(新能源仿真工作站)

yaml

塔式工作站配置: CPU: Intel Xeon W9-3495X (56核112线程, 4.8GHz, 105MB L3) 内存: 256GB DDR5-4800 ECC (8×32GB) 存储: - 系统: 2TB NVME - 数据: 15.36TB NVMe RAID (高速池) GPU: 2× NVIDIA RTX 4090 24GB (NVLink) 扩展: 1× Intel X520 万兆网卡 电源: 1200W 金牌全模组 机箱: 全塔服务器级, 8×120mm风扇

配置逻辑:W9-3495X的高主频加速OpenFAST的实时仿真循环,双4090通过NVLink提供48GB显存池,支持PhysicsAI对多工况风机模型的快速推理。

2.4 消费电子热设计与电磁兼容

计算特点

-

多尺度网格:芯片级微米网格到系统级厘米网格

-

瞬态热分析:快充/峰值负载的热冲击模拟

-

电磁-热双向耦合:5G射频器件的自热效应

软件与系统清单

| 软件组件 | 版本 | 操作系统 | 授权方式 |

|---|---|---|---|

| Simcenter Flotherm | 2310 | Windows 11 | 网络浮动授权 |

| Simcenter PhysicsAI | 2024.1 | 同上 | 同上 |

| ANSYS HFSS | 2024 R1 | Windows/Linux | 弹性授权 |

| Cadence Celsius | 2023.2 | Linux | 本地授权 |

| Icepak | 2024 R1 | 同上 | ANSYS统一授权 |

硬件配置推荐(电子散热仿真终端)

yaml

紧凑型工作站: CPU: AMD Ryzen 9 9950X3D (16核32线程, 5.7GHz, 128MB 3D V-Cache) 内存: 128GB DDR5-6000 (4×32GB, EXPO II) 存储: - 系统: 1TB PCIe 5.0 NVMe - 项目: 4TB PCIe 4.0 NVMe GPU: NVIDIA RTX A4000 16GB (专业卡, 单槽设计) 显示: 27" 4K IPS (色彩校准) 外设: 3Dconnexion SpaceMouse

配置逻辑:9950X3D的超大缓存(128MB)显著加速网格遍历和矩阵组装,RTX A4000的单槽设计适合小型机箱,16GB显存满足手机/平板级设备的AI加速需求。

三、通用软件栈部署方案

3.1 操作系统环境配置

Linux服务器端(RHEL 8.8参考):

bash

# 内核参数优化 (用于大规模仿真) echo 'kernel.numa_balancing=0' >> /etc/sysctl.conf echo 'vm.swappiness=1' >> /etc/sysctl.conf echo 'vm.zone_reclaim_mode=0' >> /etc/sysctl.conf # 文件句柄与进程限制 * soft nofile 65535 * hard nofile 65535 * soft nproc 65535 * hard nproc 65535 # 安装NVIDIA驱动与CUDA sudo dnf install nvidia-driver-latest-dkms cuda-12-1 sudo dnf install nvidia-fabric-manager # 针对H100多卡

Windows工作站端:

-

启用卓越性能模式:

powercfg -duplicatescheme e9a42b02-d5df-448d-aa00-03f14749eb61 -

关闭Hyper-V以避免与仿真内核冲突

-

安装Intel oneAPI Base Toolkit (MKL加速)

3.2 PhysicsAI 特定依赖

| 组件 | 最低版本 | 用途 |

|---|---|---|

| NVIDIA GPU驱动 | 535.104+ | CUDA 12.2支持 |

| TensorRT | 8.6.1 | AI推理优化 |

| Python环境 | 3.10/3.11 | 脚本自动化 |

| MPI库 | Intel MPI 2021.9 | 分布式训练 |

四、集群部署架构建议

对于需要Simcenter PhysicsAI全功能的企业级部署,建议采用分层架构:

plain

[AI训练层] 4× H100 Node (InfiniBand全连接)

↓

[仿真计算层] 8× CPU Node (双路Platinum, 256GB/节点)

↓

[存储层] 并行文件系统 (BeeGFS/Lustre, 100GB/s聚合带宽)

↓

[可视化层] 虚拟桌面 (NVIDIA vGPU, Teradici/PCoIP协议)

关键配置要点:

-

GPUDirect Storage:避免CPU中转,直接从存储加载训练数据到GPU显存

-

NCCL优化:多节点AI训练时的通信优化,减少PhysicsAI模型同步延迟

-

内存溢出保护:设置

CUDA_MPS_PIPE_DIRECTORY防止多任务显存冲突

五、成本效益与扩展路径

表格

| 应用阶段 | 推荐配置 | 预算区间 | ROI指标 |

|---|---|---|---|

| 试点验证 | 单路工作站 (Threadripper + RTX 4090) | 5-8万元 | 仿真周期缩短50% |

| 部门级部署 | 双路服务器 + 2×A6000 | 15-20万元 | 设计迭代效率提升3倍 |

| 企业级集群 | 8节点GPU集群 + 并行存储 | 80-150万元 | 物理原型减少70% |

扩展建议:优先投资内存容量和GPU显存,Simcenter PhysicsAI的代理模型训练对显存容量敏感,而传统物理求解器依赖内存带宽。建议采用液冷方案以降低高频CPU/GPU的 thermal throttling,维持持续峰值性能。

这份配置清单可直接用于向客户出具UltraLAB图形工作站的技术方案,重点突出高频CPU+大容量内存+专业GPU的三位一体架构,满足AI+CAE融合计算的独特需求。

【UltraLAB 解决方案事业部】

咨询专线:400-7056-800

微信号:xasun001