低延迟·高吞吐·显存带宽敏感:UltraLAB为大模型推理打造硬核加速引擎

时间:2026-03-27 14:56:30

来源:UltraLAB图形工作站方案网站

人气:177

作者:fzm

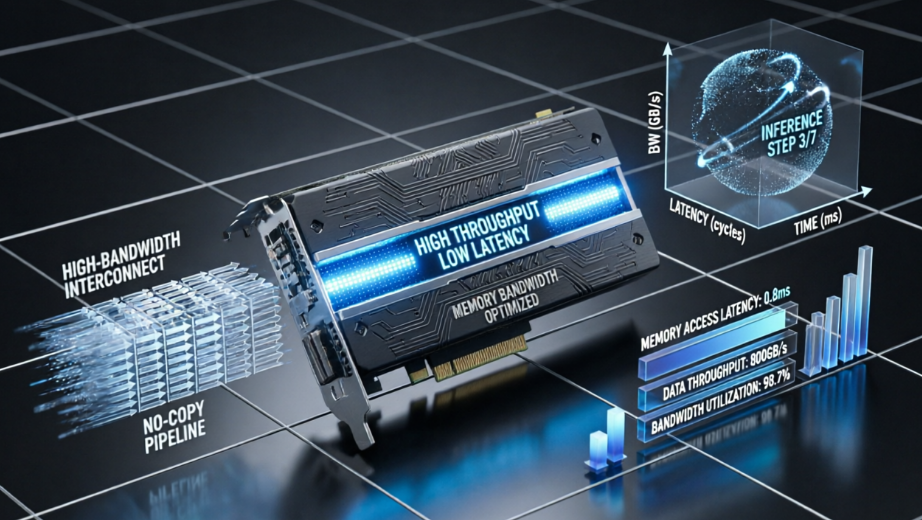

当大模型从训练走向应用,推理阶段的延迟、吞吐与显存带宽成为决定用户体验与运营成本的关键指标。vLLM的PagedAttention、TGI的连续批处理、TensorRT-LLM的内核融合——这些顶级推理引擎对硬件的要求,远非普通工作站所能满足。本文深度解构大模型推理的计算特征,并提供UltraLAB精准匹配的硬件方案。

大模型推理已成为AI工程化最核心的战场。无论是对话系统的毫秒级响应,还是内容生成的千级并发,其背后都是推理引擎与硬件架构的深度融合。vLLM、TGI(Text Generation Inference)、TensorRT-LLM等主流推理框架,通过PagedAttention、连续批处理、内核融合等技术极致压榨GPU算力——但这一切的前提是,硬件平台必须具备与之匹配的显存带宽、容量和低延迟互连。

一、大模型推理的计算特征与硬件瓶颈

1. 显存带宽:决定生成速度的“高速公路”

大模型推理的核心瓶颈并非算力,而是显存带宽。以70B模型为例:

-

每次生成一个Token,需加载全部模型权重(BF16约140GB)到计算单元

-

实际计算量远小于数据搬运量,生成速度直接受限于显存带宽

硬件要求:

-

HBM3/HBM3e(带宽≥3TB/s)优于GDDR6X(≈1TB/s)

-

高带宽显存可显著提升首Token延迟与后续生成速率

2. 显存容量:决定“能服务多大模型”的硬约束

推理阶段显存消耗主要来自:

-

模型权重:FP16下70B约140GB,INT4量化后约35GB

-

KV Cache:每个请求的键值缓存,随上下文长度线性增长(2048 tokens时约2-4GB/请求)

-

批处理缓冲区:并发请求数×单请求KV Cache

硬件要求:

-

单卡显存需≥80GB方可承载70B级模型FP16推理

-

48GB显存可通过INT4量化承载70B模型,但可能损失精度

3. 低延迟:从“首Token时间”到“每秒Token数”

实时交互场景要求:

-

首Token延迟:<200ms(含Prompt处理时间)

-

生成速率:>50 tokens/s(用户无感知等待)

硬件要求:

-

高频CPU(≥5.0GHz)加速Prompt Tokenization与调度逻辑

-

高带宽显存保障生成阶段持续供给

4. 高吞吐:服务千级并发的规模化能力

高并发场景下,推理引擎通过连续批处理(Continuous Batching)动态合并请求,最大化GPU利用率。此时:

-

显存容量决定最大并发数

-

卡间通信带宽(多卡场景)决定并行扩展效率

硬件要求:

-

多卡NVLink全互联(≥900GB/s)优于PCIe桥接

-

充足内存缓存请求队列与中间结果

二、UltraLAB大模型推理硬件方案

方案A:单卡旗舰推理节点

适用场景:70B级模型FP16推理、高并发服务部署、研发团队推理测试

性能预估:

-

Llama3-70B FP16,首Token延迟<150ms,生成速率>50 tokens/s

-

支持并发请求数:32-64(视上下文长度而定)

方案B:多卡高吞吐推理集群节点

适用场景:千级并发API服务、多模型混合部署、RLHF推理数据采集

技术亮点:

-

支持Tensor Parallel + Pipeline Parallel混合并行

-

内置NVSwitch,8卡TP时通信带宽无瓶颈

-

预装vLLM/TGI,开箱即用

方案C:边缘端低延迟推理节点

适用场景:实时语音对话、嵌入式AI、科研机构本地化部署

性能预估:

-

Qwen2.5-32B FP16,首Token延迟<80ms,生成速率>40 tokens/s

-

70B INT4量化,显存占用约35GB,生成速率>30 tokens/s

三、关键优化技术

1. PagedAttention(vLLM核心机制)

-

原理:将KV Cache分页管理,消除显存碎片,提升显存利用率

-

硬件适配:需GPU支持虚拟内存地址映射(所有现代GPU均支持),高显存带宽提升分页访问效率

2. 连续批处理(Continuous Batching)

-

原理:不等整批完成,动态插入新请求,最大化GPU利用率

-

硬件适配:需要CPU具备快速调度能力(高主频多核),同时显存容量需足够容纳动态增长的批处理缓存

3. 内核融合(TensorRT-LLM)

-

原理:将多层算子融合为单一CUDA内核,减少显存读写与内核启动开销

-

硬件适配:依赖GPU的Tensor Core加速融合后的大矩阵运算,对显存带宽友好

4. 量化与稀疏化

-

INT4/INT8量化:将模型权重压缩至4-8位,显存占用降至1/4-1⁄2

-

硬件适配:需GPU原生支持低精度计算(如NVIDIA Ada Lovelace及以上架构)

四、结语:推理效率是AI落地的“最后一公里”

大模型的价值最终通过推理服务兑现。无论是对外提供API的千级并发,还是嵌入智能设备的毫秒级响应,背后都是推理引擎与硬件架构的深度协同。vLLM、TGI、TensorRT-LLM等框架已从软件层面极致优化,但要释放其全部潜能,硬件平台必须具备:

-

高显存带宽:突破生成速度瓶颈

-

大显存容量:承载更大模型与更高并发

-

低延迟互连:支撑多卡并行扩展

UltraLAB大模型推理方案,正是基于对这一技术栈的深度理解而设计。从单卡旗舰到多卡集群,每一款工作站的配置逻辑都源自真实推理负载的量化分析——让研究者和工程师专注于模型与业务创新,而非底层算力适配的复杂性。

如需针对具体模型规模(7B/70B)、推理框架(vLLM/TGI/TensorRT-LLM)及并发量级的定制化配置,欢迎联系UltraLAB技术顾问团队。

UltraLAB图形工作站供货商:

西安坤隆计算机科技有限公司

国内知名高端定制图形工作站厂家

咨询微信号: